موجز إعلام بلس (AI Voice)

اضغط للاستماع إلى النشرة بصوت المذيع الآلي

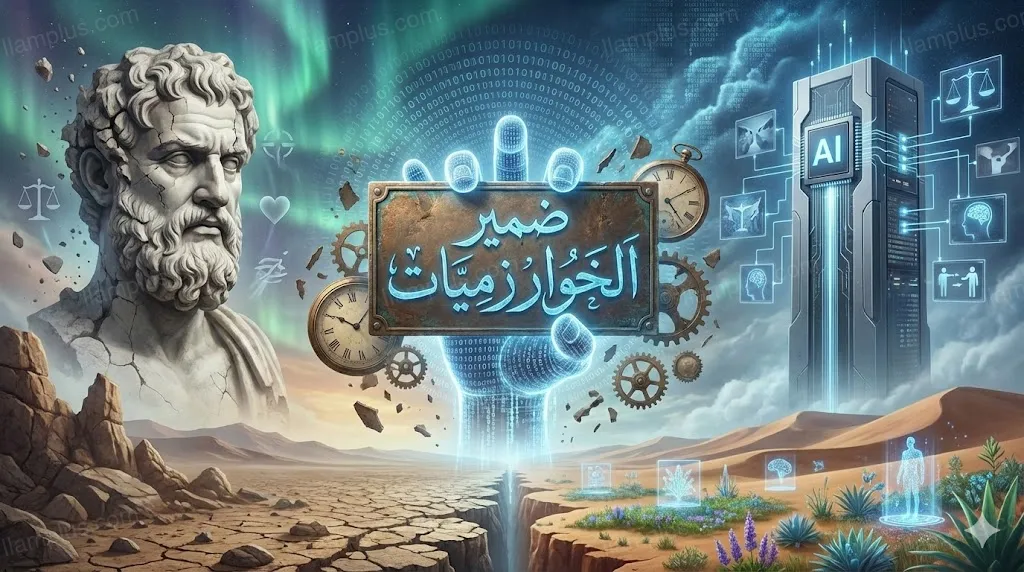

الذكاء ليس وعياً

يعيش العالم انبهاراً تقنياً بقدرات الذكاء الاصطناعي التليدي، وتتصاعد المخاوف من “تمرد الآلة”. لكن الخطر الأقرب والأكثر واقعية ليس أن تصبح الآلة واعية (وهو أمر مستحيل من منظور إيماني وفلسفي، فالروح سر إلهي)، بل الخطر هو أن يتنازل الإنسان عن وعيه ومسؤوليته الأخلاقية لصالح “الخوارزمية”.

الآلة، مهما بلغت سرعتها، تعمل داخل إطار “الكم” و”البيانات”. هي لا تملك “ضميراً” يؤنبها، ولا “فطرة” ترشدها، ولا تخاف الله واليوم الآخر. عندما نُحكّم الآلة في مصائر البشر (من التوظيف إلى القضاء إلى الحروب)، فإننا نُخضع الإنسان لمنطق رياضي بارد لا يعرف الرحمة ولا الاستثناء.

أخلاقيات “الصندوق الأسود”

المشكلة تكمن في أننا نصنع أصناماً جديدة نعبدها من دون الله تسمى “البيانات الضخمة” (Big Data). نحن نثق في اقتراحات “جوجل” أكثر من ثقتنا في حدسنا أو استشارة ذوي الخبرة. هذا التسليم يؤدي إلى:

- ضمور الملكات الإنسانية: كالتذكر، والتوجه، والقرار، لأننا نعتمد كلياً على المساعد الذكي.

- التحيز الخفي: الخوارزميات يبرمجها بشر، وهي تعيد إنتاج تحيزاتهم العنصرية أو المادية ولكن بغطاء “علمي” وموضوعي مزعوم.

التحدي الأخلاقي للقرن الحادي والعشرين هو: هل نستخدم الذكاء الاصطناعي لخدمة الإنسان، أم نعيد هندسة الإنسان ليتلائم مع الذكاء الاصطناعي؟

من منظور حضاري، التقنية يجب أن تظل “أداة” (Instrument) وليست “حاكماً” (Governor). يجب وضع خطوط حمراء أخلاقية لا تتجاوزها الآلة، والحفاظ على مساحات إنسانية محرمة على الأتمتة. كرامة الإنسان تقتضي ألا يُحكم إلا من قبل من يملك قلباً يشعر ومسؤولية تُحاسب.